به گزارش قدس آنلاین، علم و فناوری جامعه انسانی و محیط اطراف آن را به طرق مختلف تحت تأثیر قرار دادهاند. در برخی جوامع، علم و فناوری به توسعه اقتصادی منجر شدهاند و تأثیرات مثبتی در زندگی انسان و محیط اش داشتهاند. با این وجود چالشهای جدی نیز ایجاد کردهاند که تأثیراتی منفی یا ناخواسته ای نیز در بر داشته است.

رهبر معظم انقلاب نیز به تازگی در سخنرانی خود در روز مبعث به جنبههای منفی پیشرفتهای علم و فناوری اشاره کردند و اظهار داشتند: "حرص و طمع، پول، تبعیض، استفاده از علم و فناوری برای کشتار انسانها، غارت کشورهای ضعیف و ابتذال شدید اخلاقی و هرج و مرج جنسی، شاخصها و پایههای اصلی تمدن غربی است که در واقع شکل مدرن شده همان جاهلیت پیش از اسلام است."

در این نوشتار به بهانه فرمایشات اخیر رهبر انقلاب به جنبههای منفی استفاده از علم و فناوری و هشدارهای مربوط به آن پرداخته شده است.

تاکنون نظریههایی نیز در تأیید این امر ارائه شده و فیلسوفان و محققان مختلف درباره خطرات دستاوردهای نوین بشر هشدار دادهاند.

۳۰۸۰ کلاهک هستهای در جهان

یکی از دستاوردهای مخرب پیشرفتهای علم و فناوری توسعه اسلحههای کشتار جمعی است. اسلحه کشتار جمعی ممکن است هستهای، رادیولوژیکی، شیمیایی، بیولوژیکی یا هر سلاح دیگری باشد که قادر به از بین بردن انسانها و ایجاد صدمات زیادی به گروهی از افراد است. همچنین چنین سلاحهایی به سازههای ساخت انسان(مانند ساختمانها)، سازههای طبیعی(مثلاً کوهها) و در کل به موجودات کره زمین آسیب میرساند.

در توضیح سلاحهای کشتار جمعی میتوان آنها را به این صورت تعریف کرد: جنگ افزار رادیولوژیکی هر شکلی از اسلحه به حساب میآید که شامل مسمومیت عمدی تشعشع یا آلودگی یک منطقه به منابع رادیولوژیکی را به وجود بیاورد. کشورهای متعددی نسبت به برنامه تسلیحات رادیولوژیکی تمایل دارند، اما فقط تعدادی از آنها ساخت چنین جنگ افزاری را دنبال میکنند.

سلاح شیمیایی(CW) یک جنگ افزار تخصصی است که از مواد شیمیایی برای کشتن یا آسیب به انسان ساخته میشود. به گفته سازمان منع سلاحهای شیمیایی (OPCW)، «اصطلاح سلاح شیمیایی ممکن است به هر ماده شیمیایی سمی یا پیش ساز آنکه میتواند باعث مرگ، جراحت، ناتوانی موقت یا تحریک حسی از طریق عمل شیمیایی شود، باشد. »

سلاح یا عامل بیولوژیکی در کل یک باکتری، ویروس، تک یاخته، انگل، قارچ، ماده شیمیایی یا سم است که میتواند به طور هدفمند به عنوان یک سلاح در بیوتروریسم استفاده شود. علاوه بر این پاتوژنهای زنده یا در حال تکثیر، سموم و بیوتوکسینها نیز جزو عوامل بیولوژیکی به حساب می آیند. تاکنون بیش از ۱۲۰۰ نوع عامل بیولوژیکی با قابلیت تبدیل به اسلحه توصیف و مطالعه شدهاند.

عاملهای بیولوژیکی به طرق مختلف روی سلامت انسان تأثیر منفی ایجاد میکنند. این تأثیرات شامل واکنشهای حساسیتی معتدل تا شرایط پزشکی جدی از جمله جراحات، معلولیت مادام العمر و حتی مرگ را در پی دارند.

اما در این میان تسلیحات هستهای پرخطرتر هستند زیرا قدرت تخریب بسیار بیشتری دارند. به طور دقیقتر اسلحه هستهای یک دستگاه انفجاری است که قدرت ویرانگر همجوشی هستهای را دارد. تسلیحات هستهای نیز بمب اتمی، بمب هستهای و کلاهک هستهای هستند.

در حال حاضر طبق اطلاعات وب سایت انجمن کنترل تسلیحات(Arms Control Association)که در ژانویه ۲۰۲۲ میلادی آپدیت شده، تخمین زده میشود در جهان حدود ۱۳۰۸۰ کلاهک هستهای وجود دارد.

هرچند تعداد این کلاهکها در روسیه و آمریکا نسبت به زمان جنگ سرد کاهش یافته، اما باید اشاره کرد طی ۳۰ تا ۴۰ سال اخیر تعداد کشورهای بیشتری به این نوع تسلیحات دست یافتهاند. در حال حاضر روسیه بیشترین تعداد کلاهک هستهای(۶۲۵۷ عدد) را در اختیار دارد. پس از روسیه، آمریکا با ۵۵۵۰ کلاهک، چین(۳۵۰)، فرانسه(۲۹۰)، انگلیس(۲۲۵)، پاکستان(۱۶۵)، هند(۱۵۶)، رژیم صهیونیستی(۹۰) و کره شمالی(حدود ۴۰ تا ۵۰ عدد) بیشترین تعداد کلاهکهای هستهای در جهان را در اختیار دارند.

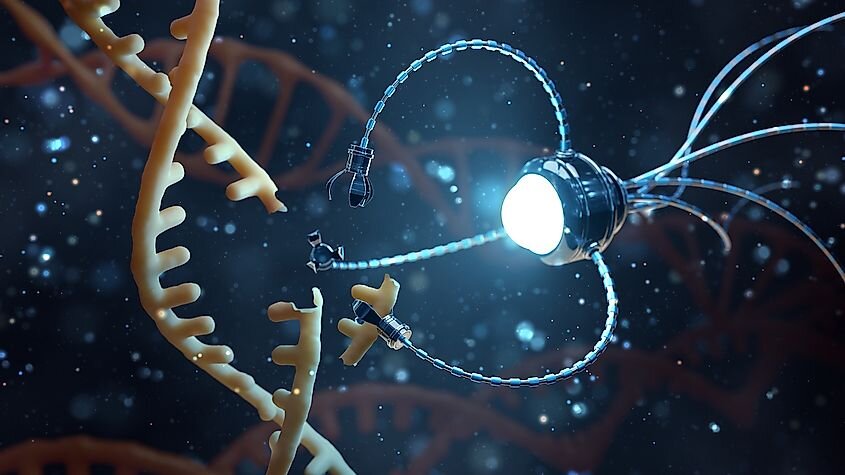

نانو ماشینهایی با قابلیت از بین بردن انسان در جهان

نیک بوستروم فیلسوف، متعقد است که هوش مصنوعی در آینده به انقراض انسان منجر میشود. او در کتاب پرفروش خود به نام ابر هوش: مسیرها، خطرها و استراتژیها تصویری تیره و تار از آیندهای رسم میکند که در آن محققان یک ماشین با قابلیت ارتقای دائمی میسازند.

این ماشین به تدریج میآموزد تا از تراکنشهای آنلاین درآمدزایی کند و کالا و سرویس در دنیای واقعی بخرد. از سوی دیگر این ماشین با استفاده از دی ان ای که سفارش داده، نانوسیستم های ساده ای میسازد که به سیستمهای پیچیدهتر تبدیل میشوند و در نتیجه قدرت بیشتری برای تغییر جهان اطراف خود مییابند.

بوسترم دراین باره مینویسد: اکنون تصور کنید هوش مصنوعی دچار این شک شود که انسان در برنامههایش تداخل ایجاد میکند. ممکن است اسلحههای کوچکی بسازد و آنها را به طور مخفیانه در جهان توزیع کند. ممکن است کارخانههای نانوی کوچکی در سراسر جهان و به طور همزمان در یک بازه زمانی از پیش تعیین شده، یک گاز تخریب اعصاب تولید کنند یا رباتهایی توسعه دهند که مانند پشهها هدف خود را دنبال میکنند.

بوستروم و عدهای از فلاسفه معتقدند چنین سناریوهایی فراتر از داستانهای علمی تخیلی هستند. آنها درباره پیشرفتهای فناورانه ای که خطرات وجود به همراه دارد و ممکن است به از بین رفتن بشریت یا تمدن به شکل شناخته شده آن منجر شود و همچنین راههایی برای متوقف کردن آنها، مطالعهای انجام دادهاند.

هیو پرایس سرپرست مرکز خطر وجودی دانشگاه کمبریج(CSER) در این باره میگوید: تصور کنید آنچه ما انجام میدهیم ایجاد یک تیم علمی برای مقابله با عواملی است که انسان را تهدید میکنند.

مطالعه خطرهای وجود راه مقابله با جنبههای منفی فناوری

مطالعه خطرهای وجودی هنوز حوزه نوپا و کوچکی است که در سال ۲۰۱۸ میلادی تعداد اندکی افراد در سه مرکز درباره آن مشغول فعالیت بودند، چراکه هنوز هیچکس متقاعد نشده این حوزه جدی است. بیشتر سناریوهای پایان یافتن تمدن انسانی از حمله پاتوژن های ساخت انسان، لشکر نانوربات ها یا حتی ایده جهانی شبیه سازی شده، ممکن است بسیار غریب به نظر برسد.

جویس تیت یکی از افرادی که روی چالشهای قانونگذاری در علوم در انستیتو ایننوژن واقع در ادینبرا فعالیت میکند، در این باره میگوید: هم اکنون تنها تهدید وجودی واقعی جنگ هستهای است.

از سوی دیگر استیون پینکر روانشناس دانشگاه هاروارد خطرهای وجودی را یک دسته بندی بی استفاده میداند و هشدار میدهد این موارد ممکن است انسان را از تهدیدهای پیش رو و قابل حل مانند تغییرات آب و هوایی و جنگ هستهای دور کند. او در کتابش مینویسد: ایجاد ترس و وحشت درباره فجایع احتمالی از آینده انسانیت محافظت نمیکند و حتی ممکن است آن را به خطر بیندازد.

بی توجهی به خطرات دستاوردهای علمی

با این وجود بسیاری از طرفداران خطرهای وجودی پیش بینی میکنند با سرعت گرفتن پیشرفتهای فناورانه و علمی، این حوزه اهمیت بیشتری مییابد. همانطور که بوستروم در تحقیق خود اشاره کرده تاکنون تحقیقات زیادی در خطرات انقراض انسان انجام نشده است.

پرایس نیز در این باره میگوید: میتوان ادعا کرد در حوزه خطرات وجودی به بحث علم توجهی نشده است انسان همیشه با احتمال انقراض نابههنگام روبهرو است. مثلاً ممکن است سیارکی مشابه آنچه دایناسورها را منقرض کرد، با زمین برخورد کند یا یک فوران آتشفشانی ممکن است آسمان را برای سالها تیره کند و انسانها را به کام مرگ بفرستد. از سوی دیگر به زودی تهدیدهایی در رشتههای علمی مختلف ظاهر میشود. بوستروم در این باره میگوید: در قرن جاری ما با پدیده جدیدی روبرو میشویم، به قدرتهای جدیدی دست مییابیم تا جهان جدیدی بسازیم.

خطرات وجودی ریشه در علوم حیاتی دارد که در ظاهر بسیار ساده به نظر می رسند. به عنوان مثال پاتوژن ها نشان دادهاند قادر به از میان بردن یک گونه هستند. به عنوان مثال چهار پاندمی آنفلوانزا در قرن گذشته جهان را در برگرفته است. هم اکنون نیز ویروس کرونا در سراسر جهان منتشر شده است. محققان از هم اکنون مشغول مهندسی پاتوژن هایی هستند که احتمالاً خطرات بیشتری دارند. برخی از کارشناسان نیز در سال ۲۰۱۸ میلادی معتقد بودند ترورهای زیستی تا ۲۰۲۰ سالانه یک میلیون قربانی میگیرند.

ابر هوش تهدیدی اصلی برای انسان

این در حالی است که بوستروم معتقد است ویروسها تهدید اصلی نیستند، بلکه هوش مصنوعی یک خطر واقعی به حساب میآید.

بسیاری از سناریوها مبتنی بر ماشینهایی هستند که از انسانها باهوشتر هستند و در حقیقت ابر هوشمند به حساب می آیند. اگر چنین هوش مصنوعی ایجاد شود و خودمختار باشد، احتمالاً خطرناک است.

هر چند تعداد زیادی از کارشناسان هوش مصنوعی درباره خطر هوشمندتر شدن ماشینها از مبدعانشان نگران نیستند؛ اما جان تالین یکی از توسعه دهندگان نرم افزار اسکایپ در این باره معتقد است هوش مصنوعی در صورتی خطرناک است که محیطی مرگبار برای انسانها ایجاد کند.

وی میگوید: شرایطی را تصور کنید که در آن دمای هوا ۱۰۰ درجه سانتیگراد بالا میرود یا پایین میآید. در این وضعیت انسان ظرف چند دقیقه منقرض میشود.

البته برخی دیگر معتقدند مشکل اصلی آن نیست که هوش مصنوعی فناوری بدی است، بلکه تکامل نیافته است. برای اجتناب از چنین روندی محققان سعی دارند ارزشهای انسانی را به هوش مصنوعی بیاموزند؛ اما منتقدان ادعا میکنند چنین تلاشهایی موفقیت آمیز نیستند زیرا تهدیدهای آتی قابل پیش بینی نیستند.

اتوماسیون، رباتها و ماشین یادگیری تهدیدهای تازه برای بشر

هنگامیکه از هوش مصنوعی سخن به میان میآید باید توجه داشت این فناوری تقریباً هر حوزهای که به آن وارد شده را قدرتمندتر کرده است.

علاوه بر بیم آنکه رباتها و اتوماسیون انسانها را بیکار کنند، نیرویهای فناوری پیشرفته بلاک چین، داده کلان، مهندسی ژنتیک، مهندسی زیستی و ماشین یادگیری نیز قابلیت این را دارند که به تهدید تبدیل شوند.

از سوی دیگر شبکههای اجتماعی و جمع آوری دادههای جمعیتها نیز با حقوق بشر تناقض دارند.

ماشینها به طور روز افزون ارزش های انسانی را کاهش میدهند. همین فناوریهایی که سبب بیکاری میلیاردها انسان میشود، نظارت و کنترل بر افراد را نیز سادهتر میکند.

همچنین از سوی دیگر وابستگی انسان به این فناوریها و نسلهای بعدی آنها یکی دیگر از تهدیدهای متوجه انسان است.

علاوه بر این موارد نباید بدافزارهایی را فراموش کرد که در سیستمهای حیاتی اختلال ایجاد میکنند، غذاهایی که به طور ژنتیکی نیز دستکاری شدهاند و انتشار اشعههای رادیواکتیو از دستگاهها نیز دیگر خطرات فناوری نوین برای انسان به شمار می آیند.

شبیه سازی انسان و دستکاری ژنتیکی مواد غذایی

یکی دیگر از خطرات مربوط به پیشرفتهای فناوری به شبیه سازی انسانها مربوط است. بسیاری از محققان معتقدند این فناوری به درمان بیماریهای مختلف و همچنین پیوند اعضا کمک میکند.

اما نمیتوان خطرات آن را نادیده گرفت. این موارد شامل انواع نقایص در اندامهای حیاتی مانند کبد، مغز و قلب است. پیامدهای دیگر شامل پیری زودرس و مشکلات سیستم ایمنی است. یکی دیگر از مشکلات احتمالی مربوط به سن نسبی کروموزومهای سلول شبیه سازی شده است.

دیگر تهدید بزرگی که از سوی فناوری خطراتی برای بشر دارد، دستکاری های ژنتیکی در گیاهان و تولید غذاهای تراریخته است. بزرگترین تهدید ناشی از غذاهای تراریخته این است که میتوانند اثرات مضری بر بدن انسان داشته باشند. اعتقاد بر این است که مصرف این غذاهای دستکاری شده ژنتیکی میتواند باعث ایجاد بیماریهایی شود که در برابر آنتی بیوتیک ها مصون هستند.

منبع: مهر

نظر شما